Explore Any Narratives

Discover and contribute to detailed historical accounts and cultural stories. Share your knowledge and engage with enthusiasts worldwide.

Le 1er janvier 2026, à 00h01 heure locale, plusieurs centaines d'entreprises technologiques basées en Californie ont dû activer de nouveaux protocoles. Leurs algorithmes d'IA ont été scrutés, leurs contrats de service mis à jour, leurs équipes juridiques placées en état d'alerte. Ce n'était pas le début d'une cyberattaque, mais l'entrée en vigueur d'un nouveau corpus législatif. Pendant ce temps, à Washington D.C., une task force fédérale se réunissait pour la première fois, mandatée par un ordre exécutif signé le 11 décembre 2025. Sa mission : identifier et contester ces mêmes lois. L'année 2026 ne sera pas une année de consensus, mais de conflit ouvert pour l'âme de la régulation tech américaine.

En l'absence d'une loi fédérale complète sur l'intelligence artificielle ou la vie privée, les États-Unis fonctionnent comme cinquante laboratoires de démocratie. En 2026, la Californie, avec son économie qui rivaliserait avec la cinquième puissance mondiale, assume pleinement son rôle de pionnier. Ses nouvelles règles, entrées en vigueur ce jour de l'an, dessinent un périmètre de contraintes inédit. Elles ciblent spécifiquement les acteurs dominants, ceux dont le chiffre d'affaires annuel dépasse un certain seuil. L'objectif est double : imposer de la transparence sur les systèmes opaques et empêcher les dérives les plus flagrantes.

Parmi les dispositions les plus marquantes, l'interdiction pour une entreprise de se défendre en justice en affirmant qu'un système d'IA a agi de manière autonome et imprévisible. Cette clause ferme une échappatoire juridique potentielle. Dans le domaine médical, il est désormais interdit de déployer une IA qui se ferait passer pour un professionnel de santé humain sans divulgation claire. La loi s'attaque aussi frontalement aux contenus synthétiques nuisibles, en prohibant les deepfakes pornographiques non consentis. Un autre front s'ouvre avec les chatbots compagnons, particulièrement ceux ciblant les mineurs, qui doivent désormais inclure des avertissements obligatoires et empêcher la génération de contenus sexuels explicites.

La California Consumer Privacy Agency a déclaré : "Ces lois ne sont pas conçues pour étouffer l'innovation, mais pour en définir les garde-fous éthiques. Quand une technologie pénètre chaque aspect de la vie privée, de la santé et de l'information, le public a le droit de savoir comment elle fonctionne et qui est responsable lorsqu'elle dysfonctionne."

Parallèlement, une autre loi californienne, AB 325, s'attaque à un problème différent mais tout aussi sensible : la fixation des prix. Elle interdit désormais les algorithmes de tarification partagés entre concurrents, une pratique qui pouvait faciliter des ententes collusoires déguisées en simple optimisation algorithmique. L'ensemble de ce cadre place un fardeau de conformité substantiel sur les géants de la tech, mais aussi sur toute entreprise de taille importante utilisant ces outils. Le message est sans équivoque : en Californie, le laissez-faire technologique a vécu.

Alors que les législatures d'État préparent leurs arsenaux réglementaires, la Maison Blanche a riposté. L'ordre exécutif signé par le président Trump fin 2025 représente une philosophie radicalement différente. Il ne propose pas une régulation fédérale alternative, mais un mécanisme de démantèlement des régulations étatiques. L'outil principal est la préemption, un principe juridique qui permet au droit fédéral de primer sur le droit des États.

Le document crée une task force inter-agences dirigée par le Bureau de la Politique Scientifique et Technologique de la Maison Blanche. Son mandat est direct : identifier les lois étatiques "inutilement onéreuses" qui entravent l'innovation et le commerce inter-États, et engager des poursuites ou d'autres actions pour les contester. Cette évaluation, attendue pour mars 2026, dressera la première liste noire des législations ciblées. Mais l'ordre exécutif ne se contente pas de la menace judiciaire. Il utilise aussi le levier financier.

Un analyste du cabinet d'avocats King & Spalding, qui a analysé l'ordre exécutif, note : "La conditionnalité des fonds fédéraux est l'arme la plus puissante. Des programmes comme le Broadband Equity Access and Deployment Program pourraient être refusés aux États dont les lois sont jugées trop restrictives. C'est une pression économique directe sur les gouvernements locaux pour qu'ils revoient leur copie."

L'ordre exécutif charge également la Federal Trade Commission (FTC) et la Federal Communications Commission (FCC) d'élaborer des normes fédérales préemptives dans des domaines clés. L'idée est de créer un plancher réglementaire minimal et uniforme qui invaliderait automatiquement les lois d'État plus strictes. Fait notable, l'ordre exempte explicitement deux domaines de cette offensive : les régulations concernant la sécurité des enfants en ligne et celles relatives aux achats publics (procurement). Cette exemption stratégique isole ces sujets, politiquement sensibles, du champ de bataille principal.

Entre la Californie agressive et Washington défensive, d'autres États tracent leur propre voie, créant une mosaïque législative complexe. Le Colorado, avec sa loi SB 24-205, a opté pour une approche centrée sur la transparence et la lutte contre les biais. Elle oblige les développeurs de systèmes d'IA à "haut risque" – utilisés dans l'emploi, les services financiers, ou l'accès aux services publics – à publier des résumés d'impact et à mettre en œuvre des mesures de lutte contre la discrimination algorithmique. Cette loi est déjà dans le collimateur de l'administration fédérale, qui la cite comme un exemple de régulation potentiellement préemptible.

Le Texas, lui, a adopté la Regulation of Artificial Intelligence Systems Act (RAIGA). Son axe est l'interdiction de l'utilisation de l'IA à des fins de discrimination illégale ou pour causer un préjudice économique ou physique. De manière plus controversée, le Texas, à l'instar de l'Utah, a adopté des lois imposant une vérification d'âge stricte pour l'accès aux plateformes de médias sociaux et aux app stores. Ces mesures, déjà suspendues par des injonctions judiciaires en attendant des procès sur leur constitutionnalité, illustrent le deuxième front de la régulation 2026 : la protection des mineurs en ligne.

D'autres États ajoutent des pièces à ce puzzle déjà complexe. L'Indiana et le Rhode Island renforcent les droits des consommateurs sur leurs données personnelles, avec de nouveaux droits d'accès, de correction et de suppression. Le Maine exige une transparence totale sur les conditions des abonnements et impose une procédure de résiliation simplifiée. Le Nevada régule l'utilisation des médias synthétiques dans la publicité politique. Et au niveau fédéral, le Take It Down Act de mai 2026 oblige les plateformes à retirer rapidement les images intimes non consenties. Chaque État, chaque loi, ajoute une couche de complexité pour les entreprises qui opèrent à l'échelle nationale.

Cette fragmentation n'est pas un bug du système, mais une caractéristique historique de la gouvernance américaine. Pourtant, pour l'industrie technologique habituée à une certaine uniformité dans l'espace numérique, elle représente un cauchemar logistique et juridique. La question centrale de 2026 est de savoir si cette mosaïque va se cristalliser ou si le marteau fédéral de la préemption va la briser pour imposer une nouvelle uniformité, moins contraignante. Les premiers mois de l'année donnent le ton : une période de chaos calculé, où chaque acteur – État, gouvernement fédéral, entreprise – teste les limites de l'autre. L'innovation en 2026 ne sera pas seulement technologique. Elle sera aussi profondément juridique.

Derrière l'apparente fermeté des textes californiens se cache une réalité plus nuancée, voire décevante. Une analyse approfondie de CalMatters, publiée en décembre 2025, révèle que les régulations finalement adoptées ont été significativement édulcorées sous la pression des lobbies industriels. Les obligations de transparence sur les modèles d'IA, initialement conçues pour être exhaustives, ont été réduites à des déclarations générales. Les mécanismes de responsabilité ont été assouplis. Ce processus d'érosion législative n'est pas un accident, mais le résultat d'un intense marchandage politique où l'influence des grandes entreprises technologiques, omniprésentes dans l'État, a pesé de tout son poids.

"Les versions finales des lois ressemblent à des tigres de papier. Elles rugissent dans les communiqués de presse, mais leurs griffes ont été soigneusement limées lors des négociations en commission." — Analyste politique, CalMatters

Cette dilution a des conséquences directes. L'exigence de divulguer les informations de sécurité, présentée comme une avancée majeure, se limite souvent à des documents génériques déjà publics. La protection des lanceurs d'alerte (whistleblowers) internes existe, mais son champ d'application et les garanties contre les représailles restent flous. Quant aux directives pour les chatbots compagnons, elles imposent bien des avertissements, mais sans standard technique précis pour empêcher les dérives. Le résultat est un cadre qui donne l'impression d'un contrôle sans en offrir les moyens réels d'application. Cette approche satisfait-elle vraiment l'aspiration du public à une technologie responsable, ou construit-elle simplement une façade de régulation ?

Alors que la Californie joue sur le terrain de l'éthique et de la transparence, le Texas et l'Utah ont ouvert un front plus concret et immédiatement conflictuel : la vérification d'âge. Leur législation exige que les plateformes de médias sociaux et les app stores mettent en place des systèmes robustes pour vérifier l'âge de leurs utilisateurs, avec l'objectif déclaré de protéger les mineurs des contenus nuisibles. Le principe semble simple. Sa mise en œuvre est un champ de mines juridique et technique.

Les lois texane et utahienne ont immédiatement rencontré une résistance féroce. Des coalitions d'éditeurs et d'associations de défense des libertés civiles ont déposé des recours, obtenant des injunctions judiciaires temporaires qui suspendent leur application. Leurs arguments sont lourds de conséquences : ces lois, en imposant une collecte massive de données d'identification (comme des scans de pièce d'identité), violeraient le Premier Amendement en restreignant l'accès anonyme à l'information. Elles créeraient aussi une base de données biométriques gigantesque et hautement sensible, un risque inacceptable pour la vie privée. L'État du Texas défend sa position, mais le chemin vers une application effective est bloqué, peut-être pour des années, par les tribunaux fédéraux.

"Ces injonctions ne sont pas une surprise, elles sont la preuve d'une approche législative mal conçue. On ne peut pas sacrifier les droits constitutionnels fondamentaux de tous les utilisateurs sous prétexte de protéger une partie d'entre eux. Il existe des moyens plus ciblés et moins intrusifs." — Avocat spécialisé en droits numériques, Electronic Frontier Foundation

Cette impasse illustre le dilemme central de la régulation par les États : l'ambition de régler un problème national avec des outils locaux génère inévitablement des conflits avec des droits et des cadres juridiques qui, eux, sont fédéraux. L'initiative texane, aussi bien intentionnée soit-elle, se heurte à la réalité d'une jurisprudence établie sur la liberté d'expression en ligne. Elle démontre aussi la tendance des législateurs à sous-estimer la complexité technique et les implications en matière de vie privée de leurs propositions.

Le paysage réglementaire ne se limite pas à la côte Ouest et au Sud. D'autres États, avec des cultures politiques et des priorités différentes, ajoutent leurs propres pièces à l'édifice. Le Nevada, État pivot lors des élections nationales, a adopté une loi ciblant un problème spécifique : le contenu politique généré par l'IA. Dans un contexte de campagnes électorales de plus en plus numériques, la loi oblige à identifier clairement toute publicité ou communication électorale utilisant des médias synthétiques. C'est une réponse directe aux risques de manipulation de l'opinion par des deepfakes politiques, une menace qui hante déjà les stratèges des deux partis.

Plus au nord, New York prépare son entrée en scène pour mars 2026. Les détails de sa future législation sur l'IA sont encore en discussion, mais les contours suggèrent une approche plus sectorielle, potentiellement axée sur l'utilisation de l'IA dans le recrutement, la finance et les services publics. L'État de New York, avec son poids économique et financier colossal, a la capacité d'imposer des standards de facto à de nombreuses industries. Son cadre, s'il est suffisamment rigoureux, pourrait devenir un modèle pour d'autres États hésitants, créant un effet d'entraînement dans le Nord-Est.

"Attendez-vous à ce que New York se concentre sur l'auditabilité. Ce ne sera pas seulement une question de publication d'un rapport, mais de mettre en place des processus vérifiables par des tiers pour détecter les biais dans les systèmes qui prennent des décisions affectant la vie des gens." — Consultant en conformité réglementaire, cabinet basé à Manhattan

Parallèlement, des lois plus ciblées émergent. Le Maine s'attaque aux abonnements piégés, imposant une transparence radicale et une annulation en un clic. L'Indiana et le Rhode Island étendent les droits des résidents sur leurs données. Chaque État agit comme un laboratoire, testant une solution à un problème perçu localement. Cette décentralisation extrême est à la fois une force et une profonde faiblesse. Elle permet l'innovation réglementaire, mais elle fabrique aussi un cauchemar pour toute entreprise visant un marché national. Se conformer à la loi du Nevada sur la pub politique, à celle du Texas sur l'âge (si elle survit), à celle de Californie sur les chatbots, et à celle de New York sur les audits, nécessitera des équipes juridiques et techniques d'une taille démesurée. Les petites et moyennes entreprises seront-elles tout simplement exclues du jeu ?

L'année 2026 n'est pas un point final, mais un point d'inflexion dans une accélération réglementaire. Le calendrier est éloquent. Après l'entrée en vigueur californienne du 1er janvier et la législation new-yorkaise de mars, le printemps verra l'application (déjà reportée) de la loi fédérale Take It Down Act en mai. Cette loi, bien que fédérale, s'inscrit dans la même dynamique de protection, en forçant le retrait rapide des images intimes non consenties. Son report initial témoigne des difficultés pratiques de mise en œuvre, même au niveau fédéral.

Et la pression ne va pas retomber. Les observateurs s'attendent à ce que d'ici la fin 2026, davantage d'États rejoignent le mouvement. Les législatures du Massachusetts, de l'Illinois et de Washington étudient activement leurs propres projets de loi sur l'IA. Cette prolifération est la conséquence directe et prévisible de la stagnation législative au niveau fédéral. Depuis des années, le Congrès américain échoue à produire une loi complète sur la vie privée ou sur l'IA. Le vide ainsi créé est une invitation que les gouvernements des États, confrontés aux demandes de leurs électeurs, ne pouvaient refuser.

"Nous assistons à une balkanisation réglementaire inévitable. Washington a abdiqué son rôle. Les États agissent non par pure volonté politique, mais par nécessité absolue. Le chaos qui en résulte est le prix à payer pour des années d'inaction fédérale." — Professeur de droit constitutionnel, Université de Georgetown

Cette course contre la montre législative pose une question fondamentale d'efficacité. Une mosaïque de cinquante lois différentes, même bien intentionnées, peut-elle réellement réguler une industrie qui est, par nature, globale et dématérialisée ? Un géant de la tech peut-il être tenu responsable de manière cohérente lorsque les règles changent à chaque frontière d'État ? Le paysage qui se dessine pour la fin de l'année 2026 est celui d'une complexité extrême, où l'énergie des entreprises et des régulateurs sera davantage consacrée à naviguer dans un dédale de règles contradictoires qu'à construire une technologie réellement plus sûre et plus éthique. L'innovation régulatrice, dans sa forme actuelle, ressemble de plus en plus à une fuite en avant désordonnée.

La bataille réglementaire de 2026 dépasse largement le simple cadre des politiques technologiques. Elle représente un test fondamental sur l'équilibre des pouvoirs aux États-Unis au XXIe siècle. L'offensive fédérale, via l'ordre exécutif et la menace de préemption, ne cherche pas seulement à simplifier le paysage pour les entreprises. Elle tente de réaffirmer la primauté du gouvernement central dans la gouvernance de l'économie numérique, un domaine qui a largement échappé à son contrôle pendant deux décennies. En réponse, les États, en particulier les plus grands et les plus riches, défendent leur droit souverain à protéger leurs citoyens selon leurs propres valeurs. Ce conflit pourrait redéfinir les limites du fédéralisme dans un monde où les données et les algorithmes ignorent les frontières physiques.

L'enjeu économique est tout aussi colossal. La Californie, le Texas et New York ne sont pas des États comme les autres ; ce sont des puissances économiques mondiales. Leurs régulations ne créent pas seulement des obligations locales, elles établissent des standards de facto pour l'industrie mondiale. Une entreprise chinoise ou européenne souhaitant opérer aux États-Unis doit désormais se conformer non pas à une seule loi fédérale, mais à une douzaine de régimes étatiques divergents. Cela confère un pouvoir normatif immense à ces législatures, transformant leurs décisions en règles du jeu pour le commerce international. Le coût de la conformité à cette mosaïque devient une barrière à l'entrée insurmontable pour les petits acteurs, consolidant paradoxalement la position des géants qui disposent des ressources pour naviguer cette complexité.

"Nous ne régulons pas seulement des entreprises. Nous dessinons les contours d'un nouveau contrat social pour l'ère numérique. La question est de savoir si ce contrat sera écrit par les communautés touchées par la technologie ou imposé par une autorité centrale éloignée. Le résultat déterminera qui détient le pouvoir dans la prochaine phase de la révolution numérique." — Économiste politique, The Brookings Institution

Pour aussi nécessaire que soit l'action réglementaire, l'approche actuelle présente des défauts majeurs, presque fatals. La première faille est l'incohérence criante. Une pratique algorithmique peut être transparente et encouragée au Texas, régulée de manière restrictive en Californie, et simplement interdite à New York. Cette divergence ne protège pas les citoyens ; elle crée une insécurité juridique totale et encourage les entreprises à localiser leurs serveurs et leurs équipes juridiques dans les juridictions les plus permissives, un shopping réglementaire à l'échelle nationale. La protection du citoyen devient alors un accident de la géographie, non un droit garanti.

La deuxième faille est le coût exorbitant, reporté in fine sur le consommateur. Se conformer à des dizaines de lois différentes nécessite des armées d'avocats, de consultants et d'ingénieurs. Ces coûts astronomiques sont à la portée uniquement des plus grandes entreprises. Les startups innovantes, souvent présentées comme les acteurs d'une IA plus éthique et diversifiée, sont étranglées par cette complexité. Le régime réglementaire, destiné à contrôler les géants, risque en réalité de les protéger en éliminant toute concurrence sérieuse.

Enfin, la stratégie fédérale de préemption porte en elle le germe de son propre échec. En cherchant à écraser les régulations étatiques jugées trop lourdes, l'administration fédérale pourrait provoquer un nivellement par le bas. Les standards minimaux qu'elle envisage de promulguer via la FTC risquent d'être si faibles qu'ils rendraient toute protection significative illusoire. Exempter la sécurité des enfants et les achats publics est une manœuvre politique astucieuse, mais elle laisse sans protection des domaines tout aussi critiques comme la discrimination algorithmique dans l'emploi, le logement ou le crédit. Une régulation fédérale faible mais uniforme pourrait être pire qu'une mosaïque de régulations fortes mais disparates.

L'année 2026 sera donc le théâtre d'une lutte à trois : les États régulateurs, le gouvernement fédéral préempteur, et l'industrie technologique qui manœuvre entre les deux. Les décisions prises par les tribunaux sur les injonctions au Texas et les évaluations de la task force fédérale d'ici mars 2026 donneront le ton. Les élections législatives de novembre 2026 dans de nombreux États pourraient renforcer ou au contraire remettre en cause les majorités favorables à cette régulation agressive.

La trajectoire la plus probable n'est pas une victoire claire d'un camp sur l'autre, mais un enlisement. Une série de batailles judiciaires coûteuses et prolongées, aboutissant à un patchwork de décisions contradictoires selon les circuits d'appel. Cette incertitude permanente constitue le pire des scénarios pour l'innovation. Elle ne protège pas les citoyens de manière efficace et étouffe dans l'œuf les projets technologiques à long terme. Le pays a besoin non pas de cinquante solutions différentes, ni d'une solution unique minimaliste, mais d'un cadre fédéral robuste, clair et appliqué uniformément. C'est précisément ce que le système politique américain, dans son état actuel de polarisation, semble incapable de produire.

Alors que le soleil se couchait sur Silicon Valley ce 1er janvier 2026, les serveurs des grandes plateformes continuaient de fonctionner, leurs algorithmes d'optimisation et de recommandation tournant sans relâche. Les nouvelles lois étaient activées, les déclarations de conformité rédigées, les procédures internes mises à jour. Mais dans les couloirs des cabinets d'avocats et des agences de régulation, une autre machine, tout aussi complexe, se mettait en marche : celle de la contestation, de l'interprétation et de la résistance. La vraie régulation de la technologie ne réside pas dans le texte de loi, mais dans l'application quotidienne, dans la jurisprudence qui se construira cas par cas, dans l'équilibre des pouvoirs qui se redessinera conflit après conflit. L'industrie a passé les deux dernières décennies à construire l'avenir. Les deux prochaines seront consacrées à négocier les règles pour y vivre.

Your personal space to curate, organize, and share knowledge with the world.

Discover and contribute to detailed historical accounts and cultural stories. Share your knowledge and engage with enthusiasts worldwide.

Connect with others who share your interests. Create and participate in themed boards about any topic you have in mind.

Contribute your knowledge and insights. Create engaging content and participate in meaningful discussions across multiple languages.

Already have an account? Sign in here

En 2026, les nouvelles lois tech en Californie et au Texas entrent en conflit avec un ordre fédéral, créant une bataille...

View Board

AMD lance Helios, un rack IA de 3 exaflops, défiant Nvidia avec 72 GPU MI455X et un partenariat clé avec OpenAI.

View Board

L'ère du silicium spécialisé s'ouvre avec l'ascension des ASIC et des puces modulaires, défiant l'hégémonie des GPU et r...

View Board

La Corée du Sud parie 500 millions sur FuriosaAI pour défier Nvidia avec sa puce Renegade, 40% plus économe en énergie p...

View Board

Deepgram lève 130 M$ en Série C pour dominer l'IA vocale mondiale, étend Nova-3 à 10 langues et acquiert OfOne.

View Board

TSMC domine le marché des puces IA avec des revenus records de 3 809 milliards de dollars taïwanais en 2025, mais sa dép...

View Board

Découvrez comment les PC IA, équipés de NPU dédiés, transforment nos ordinateurs en partenaires intelligents, redéfiniss...

View Board

La chute d'iRobot : comment le pionnier américain des robots domestiques, symbole d'innovation, a succombé sous les tari...

View Board

Die Reise von ELIZA zu proaktiven KI-Agenten: Wie aus reaktiven Chatbots autonome Akteure wurden, die Geschäftsprozesse ...

View Board

Steve Cutts and the Art of Satirical Social Commentary A man in a suit sits on a park bench, his face illuminated by th...

View Board

CES 2025 spotlighted AI's physical leap—robots, not jackets—revealing a stark divide between raw compute power and weara...

View Board

The open AI accelerator exchange in 2025 breaks NVIDIA's CUDA dominance, enabling seamless model deployment across diver...

View BoardThe EU AI Act became law on August 1, 2024, banning high-risk AI like biometric surveillance, while the U.S. dismantled ...

View Board

Nscale secures $2B to fuel AI's insatiable compute hunger, betting on chips, power, and speed as the new gold rush in te...

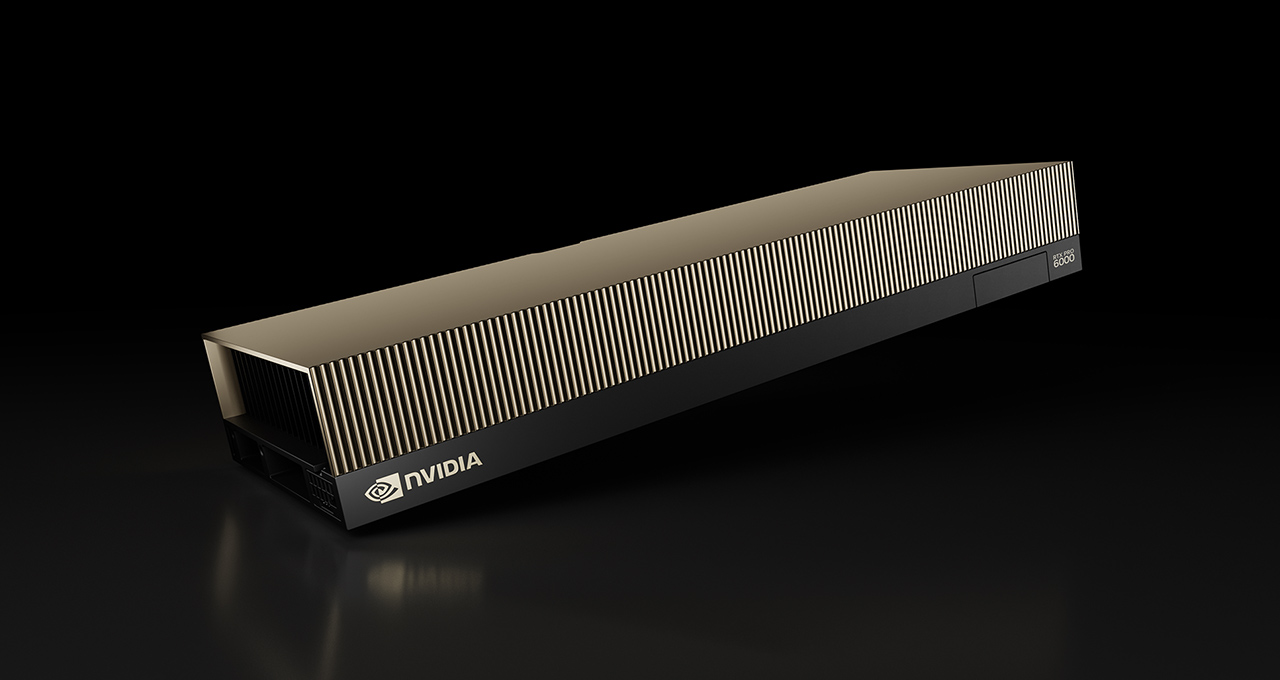

View Board

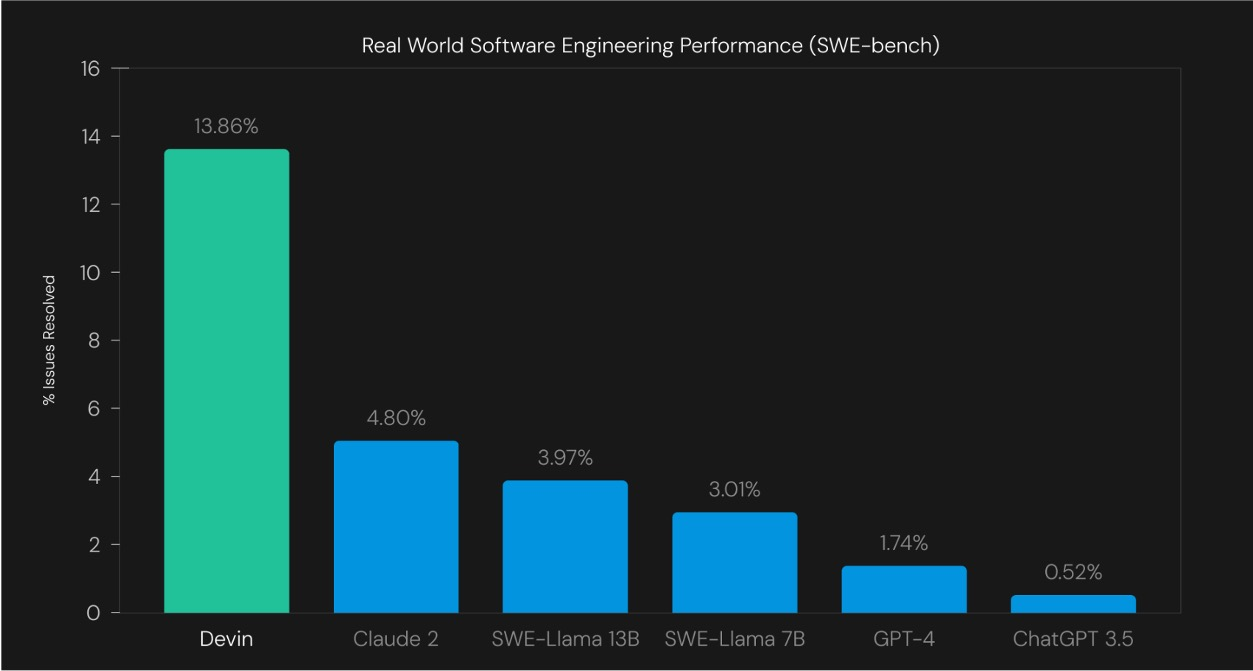

Autonomous AI agents quietly reshape work in 2026, slashing claim processing times by 38% overnight, shifting roles from...

View Board

Depthfirst's $40M Series A fuels AI-native defense against autonomous AI threats, reshaping enterprise security with con...

View Board

Tesla's Optimus Gen 3 humanoid robot now runs at 5.2 mph, autonomously navigates uneven terrain, and performs 3,000 task...

View Board

Microsoft's Copilot+ PC debuts a new computing era with dedicated NPUs delivering 40+ TOPS, enabling instant, private AI...

View Board

Archaeologists in Izmir, eng, uncover a 1,500-year-old mosaic with Solomon’s Knot, revealing Smyrna’s Agora’s layered hi...

View Board

AI-driven networks redefine telecom in 2026, shifting from automation to autonomy with agentic AI predicting failures, o...

View Board

Comments